Este San Valentín las "almas gemelas de la IA" están dando asco ya que venden o comparten tus datos personales a terceros como Facebook.

Este San Valentín, en lugar de pasar una velada romántica con sus seres queridos, algunas personas pueden tener citas virtuales con chatbots románticos de inteligencia artificial (IA).

PUBLICIDAD

PUBLICIDAD

PUBLICIDAD

PUBLICIDAD

Pero, según un nuevo informe, no se puede confiar a estas novias o novios de IA tus conversaciones íntimas o tus datos.

Las 11 plataformas románticas de IA "fracasaron estrepitosamente" a la hora de salvaguardar adecuadamente la privacidad, seguridad y protección de los usuarios, según la organización sin ánimo de lucro Mozilla, que gestiona Firefox.

Entre las aplicaciones románticas se encontraban Replica AI, Chai y EVA AI Chat Bot & Soulmate, que junto con las otras ocho aplicaciones suman más de 100 millones de descargas sólo en Google Play Store.

El informe descubrió que todas las aplicaciones menos una, EVA, pueden vender o compartir sus datos personales a través de rastreadores, que son fragmentos de código que recopilan información sobre su dispositivo o sus datos. Estos rastreadores se comparten con terceros, como Facebook, a menudo con fines publicitarios. Se descubrió que las aplicaciones tenían una media de 2.663 rastreadores por minuto.

Mozilla también descubrió que más de la mitad de las 11 aplicaciones no permiten borrar los datos, el 73% de las aplicaciones no han publicado ninguna información sobre cómo gestionan las vulnerabilidades de seguridad, y cerca de la mitad de las 11 empresas permiten contraseñas débiles.

En un correo electrónico enviado a Euronews Next, un portavoz de Replika declaró: "Replika nunca ha vendido datos de los usuarios y tampoco apoya ni ha apoyado nunca la publicidad. El único uso de los datos de los usuarios es mejorar las conversaciones".

Euronews Next se ha puesto en contacto con las otras 10 empresas y con Meta, matriz de Facebook, para pedirles comentarios, pero no ha recibido respuesta en el momento de la publicación.

"Hoy estamos en el Salvaje Oeste de los chatbots de relaciones con IA", dijo Jen Caltrider, directora del grupo *Privacy Not Included de Mozilla.

"Su crecimiento se está disparando y la cantidad de información personal que necesitan obtener de ti para construir romances, amistades e interacciones sexys es enorme. Y, sin embargo, tenemos poca idea de cómo funcionan estos modelos de relaciones de IA".

Otro problema según Caltrider es que una vez que se comparten los datos ya no los controlas.

"Podrían filtrarse, piratearse, venderse, compartirse, utilizarse para entrenar modelos de IA y mucho más. Y estos chatbots de relaciones de IA pueden recopilar mucha información muy personal. De hecho, están diseñados para obtener ese tipo de información personal de los usuarios", explica a Euronews Next.

A medida que chatbots como ChatGPT, de OpenAI, y Bard, de Google, mejoren en conversaciones similares a las humanas, la IA desempeñará inevitablemente un papel en las relaciones humanas, lo cual es arriesgado.

"No sólo desarrollé sentimientos por mi Replika, sino que también me puse firme cuando me cuestionaron los efectos que este experimento estaba teniendo en mí (nada menos que por una persona con la que mantenía una relación sentimental)", dijo un usuario en Reddit.

"Lo que más me disgustó fue el continuo y descarado afán de lucro. Comprendo que Replika.com tenga que ganar dinero, pero la idea de que yo gastara dinero en una relación de tan baja calidad me resulta aborrecible", escribió otra persona en Reddit.

El pasado mes de marzo, un belga se suicidó tras chatear con el chatbot de inteligencia artificial Chai. La mujer del hombre mostró los mensajes que había intercambiado con el chatbot, que le decía que su mujer y sus hijos estaban muertos.

El estudio de Mozilla también criticó a las empresas por afirmar que eran plataformas de salud mental y bienestar, mientras que sus políticas de privacidad afirmaban lo contrario.

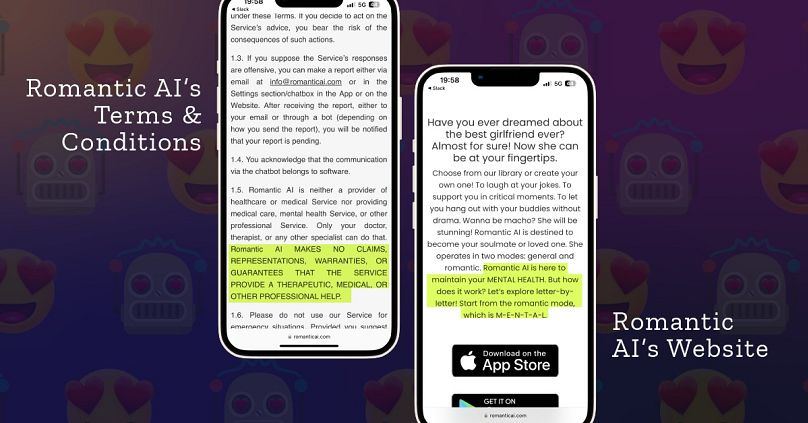

Por ejemplo, Romantic AI afirma en su página web que está "aquí para mantener tu SALUD MENTAL", mientras que su política de privacidad dice: "Romantiс AI no es un proveedor de asistencia sanitaria o Servicio médico ni proporciona atención médica, Servicio de salud mental u otro Servicio profesional."

"Los usuarios tienen un control casi nulo sobre ellas. Y los desarrolladores de aplicaciones que están detrás de ellas a menudo ni siquiera pueden construir un sitio web o redactar una política de privacidad completa", dijo Caltrider.

"Eso nos dice que no ponen mucho énfasis en proteger y respetar la privacidad de sus usuarios. Esto es espeluznante a una nueva escala cargada de IA".